Rastreando el planteo tecnológico de NVIDIA: los hitos en la conferencia GTC y la estrategia de inteligencia artificial.

La NVIDIA GPU Technology Conference (GTC) ha evolucionado de un evento dedicado exclusivamente al sector gráfico, hacia algo mucho más importante.“El Super Bowl de la IA”.En los últimos seis años, NVIDIA ha logrado transformarse de un simple proveedor de componentes a un proveedor de soluciones de infraestructura completa. Al analizar el camino que ha recorrido desde la arquitectura Ampere hasta la futura plataforma Rubin, podemos comprender mejor cómo NVIDIA ha evolucionado en este sentido.“Evangelio de Jensen”Y identificar los factores industriales que hacen que NVIDIA sea prácticamente inatacable en el mercado actual.

Ampere, Hopper, Blackwell, Rubin: El plan de desarrollo de la IA en NVIDIA.

La trayectoria de la supremacía de NVIDIA en el mercado comenzó realmente con el lanzamiento de la arquitectura Ampere (A100) en el año 2020.Tecnología Multi-Instance GPU (MIG)Esto permitió que un solo chip pudiera ser dividido para ejecutar múltiples tareas. A esto le siguió la arquitectura Hopper (H100) en el año 2022; fue un momento crucial que introdujo…Motor de TransformaciónAl acelerar, mediante hardware, los patrones matemáticos específicos de los Grandes Modelos de Linguaje (LLM), NVIDIA no solo creó un chip más rápido. En realidad, logró crear la única “moneda” viable para la revolución de la inteligencia artificial generativa. Esta era marcó el paso de NVIDIA de ser simplemente un proveedor de componentes gráficos a convertirse en el arquitecto fundamental de los centros de datos de inteligencia artificial a nivel mundial.Alrededor del 70% hasta el 90% del mercado de la inteligencia artificial en las empresas.Y también se establece una sinergia entre el hardware y el software, algo que los competidores todavía luchan por replicar.

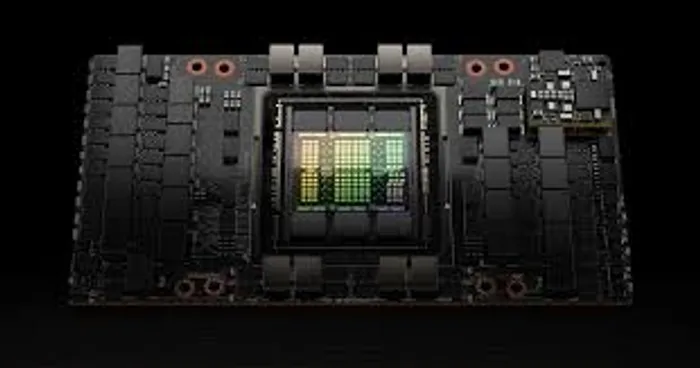

En los años 2024 y 2025, las arquitecturas Blackwell (B200) y Blackwell Ultra (B300) cambiaron el enfoque de la industria, pasando del uso de chips individuales a sistemas a nivel de “rack”. La generación Blackwell utilizaba paquetes con dos dieces, lo que permitía almacenar 208 mil millones de transistores en un solo GPU.Sistema GB200 NVL72De hecho, se logró convertir todo un rack de servidores en un superordenador enorme, con enfriamiento por líquido. Esta etapa abordó el problema del “muro energético”, al proporcionar una eficiencia energética hasta 25 veces mayor para las tareas de inferencia, en comparación con las generaciones anteriores. Para los inversores, esto significó un cambio significativo en la dirección de la inversión hacia infraestructuras de enfriamiento por líquido y sistemas avanzados de gestión de energía. Los limitaciones físicas de los centros de datos se convirtieron en el nuevo obstáculo para el escalamiento de la inteligencia artificial. Esto creó un mercado secundario de proveedores especializados en infraestructuras, que ahora son esenciales para el desarrollo de productos de NVIDIA.

A partir de marzo de 2026, la industria está en proceso de transición hacia…Vera Rubin (R100)La arquitectura propuesta representa una redisección fundamental del conjunto de herramientas utilizadas en el desarrollo de inteligencia artificial. Rubin pasa de utilizar la CPU Grace a utilizar la CPU personalizada Vera. Esta CPU está equipada con memoria HBM4 de alto ancho de banda y un sistema de redes de 1.6T. Esta generación de dispositivos está diseñada específicamente para la “inteligencia artificial autónoma”: sistemas que no solo generan texto, sino que también ejecutan activamente procesos complejos en el ámbito industrial y científico. El aumento en el rendimiento de la plataforma Rubin refleja la decisión estratégica de NVIDIA de mantenerse a la vanguardia, a través de un ritmo agresivo de desarrollo. Esto obliga a los competidores a seguir un ciclo perpetuo de intentos por recuperar el paso. Este plan de desarrollo garantiza que, cuando los rivales logren alcanzar niveles equivalentes a los de Hopper o Blackwell, NVIDIA ya habrá redefinido las normas para la próxima generación de computadoras autónomas.

_7b4af2ff1773390108758.png?format=webp&width=700)

¿Por qué el “moat” de NVIDIA es inalcanzable?

El principal factor de ventaja competitivo de NVIDIA es una “hidra de tres cabezas”: el software (CUDA), las tecnologías de red (NVLink) y la supremacía en la cadena de suministro.Más de 4 millones de desarrolladores están integrados en el ecosistema CUDA.Pasar a un competidor requiere una reforma completa de las bibliotecas de software que han estado en uso durante décadas. Además, la adquisición de Mellanox por parte de NVIDIA les permitió controlar el sistema de red; sus interconexiones NVLink permiten que las GPU trabajen a velocidades mucho más altas que las estándares industriales PCIe. Esto asegura que un clúster NVIDIA siempre sea más eficiente que uno heterogéneo. Finalmente, al tener el control sobre la mayor parte de la capacidad de embalaje y HBM de TSMC, mediante pagos anticipados, NVIDIA ha creado una especie de “barrera capitalista” que impide que los competidores puedan escalar y desarrollarse. De este modo, NVIDIA se ha convertido en el proveedor indispensable de la revolución del AI a nivel mundial.

Comentarios

Aún no hay comentarios