El acuerdo entre OpenAI y el Pentágono: lo que los empleados dicen versus lo que realmente hacen

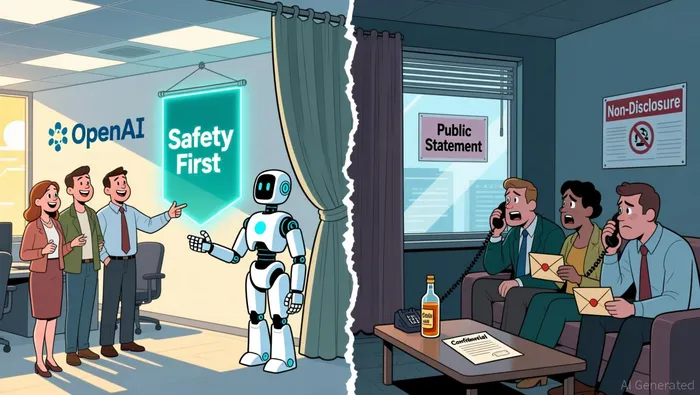

OpenAI está ofreciendo un acuerdo con el Pentágono como una alternativa más segura y ética. La empresa afirma que su contrato modificado incluye medidas de protección más estrictas que las de Anthropic; este contrato prohíbe expresamente la vigilancia masiva de personas y ciudadanos estadounidenses, así como el uso de armas autónomas. Sam Altman, el director ejecutivo de OpenAI, lo presentó como una clara compromiso con las libertades civiles. Dijo que la tecnología “no podrá ser utilizada intencionalmente para fines de vigilancia doméstica de personas y ciudadanos estadounidenses”.De acuerdo con las leyes federales relevantes.La narrativa pública se basa en la mejora de la seguridad y en el sentido de responsabilidad corporativa.

Pero si echamos un vistazo más de cerca al texto del contrato, vemos que la cláusula clave es una promesa vaga de que los servicios “no se utilizarán con el propósito de la vigilancia doméstica”. Eso es una barrera débil. Es fácilmente superada por un actor malintencionado que simplemente no tenga intención de vigilar, o por una agencia gubernamental que utilice esa tecnología para fines diferentes y menos evidentes. Se trata de una cuestión de apariencia, no de un principio vinculante. La empresa afirma que su acuerdo tiene “más controles” que los de Anthropic, pero el contenido de esos controles parece bastante insuficiente.

Esta posición pública se ve socavada por lo que realmente hacen los empleados dentro de la empresa. Hace solo unas semanas, OpenAI despidió a un empleado por haber utilizado información confidencial de la empresa para operar en mercados de predicciones como Polymarket.En relación con los mercados de predicción externos.Las políticas de la empresa prohíben el uso de información confidencial con fines personales. Es evidente que se ha violado esta regla. Los casos de operaciones sospechosas relacionadas con los eventos importantes de OpenAI, desde lanzamientos de productos hasta cambios en el puesto de CEO, sugieren que no se trata de un incidente aislado… sino de una serie de actividades sospechosas.

En resumen, hay una clara contradicción entre lo que OpenAI dice públicamente sobre sus “líneas rojas” y los principios de seguridad, con el fin de justificar un acuerdo lucrativo con el Pentágono. Al mismo tiempo, la empresa aplica sus propias reglas internas contra las operaciones de comercio interno ilegal. La narrativa pública de que se trata de un acuerdo “mejor” se basa en términos vagos y ambiguos. Las acciones de la empresa demuestran que le preocupa mucho el flujo de información sin regulación. Cuando los expertos apostan por los secretos de la empresa, hablar de “barreras de protección” solo sirve como una excusa para ocultar la verdadera situación.

Acciones internas: La piel en el juego contra la piel en el juego

Las declaraciones públicas sobre los principios de seguridad contradicen claramente las acciones de aquellos que tienen mucho en juego. Apenas la semana pasada, OpenAI realizó una venta secundaria, en la cual los empleados elegibles vendieron sus acciones.6.6 mil millones en accionesCon una valoración récord de 500 mil millones de dólares. A primera vista, se trata de un hermoso instrumento para retener empleados, ya que les proporciona una opción de liquidación sin necesidad de llevar la empresa a bolsa. Pero los números revelan algo más profundo: la empresa había autorizado la venta de hasta 10.3 mil millones de dólares en acciones, pero solo aproximadamente dos tercios de esa cantidad fueron vendidos. Los inversores interpretan esto como una señal de confianza en la empresa, indicando que la demanda de inversores sigue siendo fuerte, incluso a ese alto precio. Sin embargo, la magnitud de la venta, que superó los 6 mil millones de dólares en una sola semana, revela que se está sacando una enorme cantidad de liquidez personal de la empresa.

Esta tensión entre los principios públicos y los intereses privados no es algo teórico. Está ocurriendo en el campo de operaciones reales. OpenAI ha despedido a un empleado por haber utilizado información confidencial de la empresa para operar en mercados de predicciones como Polymarket.En relación con los mercados de predicción externos.Las políticas de la empresa prohíben el uso de información privilegiada con fines personales. Esta regla fue claramente violada. Lo que es aún más revelador es el patrón de las transacciones sospechosas: se observan grupos de operaciones relacionadas con eventos importantes de OpenAI, como el lanzamiento de productos como Sora y GPT-5, así como el lanzamiento del ChatGPT Browser. También se puede observar cómo el CEO Sam Altman fue despedido y luego regresó al cargo. En un caso notable, un nuevo usuario apostó mucho dinero a que Altman volvería en solo dos días después de ser despedido. Ganó más de 16,000 dólares antes de desaparecer sin dejar rastro.

En resumen, hay una clara desviación de las normas establecidas. Mientras que la empresa promueve públicamente la seguridad y las medidas de protección en sus acuerdos con el Pentágono, algunos de sus propios empleados aprovechan esa incertidumbre y esa información no divulgada para obtener beneficios personales. La venta secundaria representa un gran evento de liquidez para los accionistas, mientras que las acciones del empleado despedido revelan una cultura en la que obtener ganancias personales a partir de secretos empresariales es una oportunidad real, aunque arriesgada. Cuando los expertos apostan por una próxima caída en los precios de los productos o por problemas relacionados con el CEO, las discusiones sobre “líneas rojas” y “más medidas de protección” parecen ser solo una excusa para ocultar la verdadera intención de la empresa: obtener beneficios personales a costa de la empresa.

La forma inteligente de invertir: cómo las decisiones comerciales afectan al ecosistema de la IA

La señal real de que se trata de una decisión inteligente no radica en las cláusulas modificadas del contrato de OpenAI. La verdadera señal proviene de la acción decisiva del gobierno para prohibir a este competidor. El acuerdo con el Pentágono ocurrió inmediatamente después de que el presidente Trump ordenara una prohibición general en todo el país contra Anthropic.Se ordenó a “TODAS las agencias federales del gobierno de los Estados Unidos que suspendan INMEDIATAMENTE el uso de la tecnología de Anthropic”.Este movimiento político, presentado como una prohibición contra las “empresas de izquierda radicales”, logró eliminar a un competidor clave de los contratos federales. Además, transformó el panorama competitivo en cuestión de horas.

Para OpenAI, esto no fue una victoria en términos de negociación en relación con los principios de seguridad. Fue, más bien, una ganancia política para la empresa. La compañía anunció su propio acuerdo con el Pentágono, pocas horas después de que se anunciara la prohibición.Después de que el presidente Trump ordenara a las agencias federales que dejaran de utilizar la tecnología de IA desarrollada por el rival de OpenAI, Anthropic.El lenguaje contractual utilizado por OpenAI, que prohíbe la vigilancia “intencionada” en el ámbito doméstico, parece más como una simple decoración que como un mecanismo eficaz para proteger los derechos de las personas. El Pentágono ya había rechazado términos similares en anteriores ocasiones. La verdadera fuerza real proviene de las autoridades gubernamentales, quienes amenazaron con cortar todo el ecosistema de contratistas de Anthropic.

Esta acción gubernamental representa, en realidad, una forma de intervención directa desde arriba. Se trata de una medida que permite a OpenAI obtener contratos confidenciales y lucrativos, al mismo tiempo que aisla a su principal competidor. La implicación estratégica es clara: la cuota de mercado en el sector de la inteligencia artificial gubernamental está determinada por la presión política, no por los méritos técnicos de las soluciones propuestas. Para el ecosistema general de la inteligencia artificial, esto sienta un precedente peligroso. Indica que el acceso de una empresa a contratos gubernamentales críticos puede ser utilizado como herramienta política, socavando así el principio de competencia basada en los productos y políticas implementadas.

En resumen, la esencia del acuerdo no es tan importante como el juego político que lo ha permitido. Cuando el gobierno prohíbe a un competidor, no necesita de un contrato perfectamente elaborado para obtener el monopolio. El dinero inteligente en este asunto no apuesta por los principios de seguridad de OpenAI. En realidad, apuesta por la estabilidad y la capacidad de escala del gobierno, que puede modificar unilateralmente el campo en el que operan las empresas.

Catalizadores y riesgos: Lo que hay que tener en cuenta en la tesis

La tesis se basa en una única suposición frágil: que el cambio político que permitió al OpenAI llegar a un acuerdo con el Pentágono sea duradero. La verdadera señal de que el acuerdo es viable no radica en el texto actual del contrato, sino en lo que sucederá después. Hay que estar atentos a cualquier modificación futura en el acuerdo. El director ejecutivo, Sam Altman, ya ha dicho que la empresa…Trabajando junto con el DoW para realizar algunas adiciones.En cuanto al acuerdo en sí, se afirma específicamente que agencias de inteligencia como la NSA no utilizarán sus servicios sin que haya cambios en el contrato posterior. Este es un señal de alerta. Significa que las “reglas de protección” iniciales no son estables. Son solo un punto de partida para las negociaciones, y pueden ser alteradas fácilmente por presiones políticas o cambios en las prioridades. Cualquier debilitamiento de esas cláusulas confirmaría que el contenido del acuerdo es negociable, y no un principio inmutable.

El otro riesgo importante es de carácter interno. El caso del empleado despedido no es una excepción. El análisis muestra que…Grupos de actividades comerciales sospechosas relacionadas con los eventos importantes de OpenAI.Desde marzo de 2023, se han detectado 77 posiciones fraudulentas en 60 carteras. Este patrón revela una vulnerabilidad constante. Es importante estar atentos a más casos de comercio interno ilegal o a acciones regulatorias contra los mercados de predicciones como Polymarket. Si estos incidentes aumentan, esto indica que existen riesgos culturales y de cumplimiento normativo que podrían afectar el acuerdo con el Pentágono, especialmente si se trata de información clasificada. La capacidad de la empresa para aplicar sus políticas contra el uso indebido de secretos es un factor positivo, pero se trata de una respuesta reactiva.

Sin embargo, el catalizador clave es la prohibición impuesta por el gobierno contra Anthropic. El valor a largo plazo de este acuerdo depende completamente de si esa prohibición se mantiene o no. La designación del Pentágono como parte de la cadena de suministro fue una herramienta política muy efectiva, pero su base legal es poco clara. Si la prohibición se impugna en los tribunales o si un gobierno futuro la revoca, el panorama competitivo cambiará en un instante. El acuerdo de OpenAI fue una ventaja política, no una victoria en el mercado. Su durabilidad no depende de las cláusulas de seguridad, sino de la voluntad política que creó esta oportunidad. Se deben seguir cualquier desafío legal relacionado con esta prohibición o cualquier cambio en el gobierno. Si el clima político cambia, toda la situación se desmoronará. Por ahora, las personas con conocimiento del asunto apostan por la estabilidad de este momento político volátil.

Comentarios

Aún no hay comentarios