La infraestructura de IA agente de Nvidia se ha estabilizado, mientras que OpenClaw domina el mercado. Además, Vera Rubin logra un aumento de eficiencia del 50%.

El eje central del próximo crecimiento de Nvidia es un cambio fundamental en su estrategia de desarrollo. La empresa está pasando de la fase inicial, que requiere mucho capital, hacia la fase de ejecución en tiempo real de los modelos de IA. Esto no es simplemente una actualización de productos, sino una apuesta estratégica por el próximo punto de inflexión en la curva tecnológica. Como dijo Jensen Huang en GTC: “Ha llegado el momento de la ejecución en tiempo real de los modelos de IA”. La demanda de ejecutar modelos de IA en entornos de producción es ahora la necesidad informática más importante. Nvidia se posiciona como el líder indiscutible en esta nueva era tecnológica.

Las oportunidades de ingresos son asombrosas. El año pasado, Huang estimó que existían demandas de 500 mil millones de dólares. Este año, ha aumentado esa cifra significativamente, afirmando que las oportunidades de ingresos para los procesadores de IA de Nvidia podrían alcanzarAl menos $1 trillón hasta el año 2027.Se trata de un dobleamiento del mercado proyectado en solo un año. Esto indica la escala explosiva del mercado de inferencia, a medida que la adopción empresarial se acelera. Este cambio ya se refleja en los resultados financieros de Nvidia. La empresa informó que…Los ingresos registrados en el ejercicio fiscal 2026 fueron de 215.9 mil millones de dólares, lo que representa un aumento del 65% en comparación con el año anterior.El crecimiento es exponencial, impulsado por el paso del proceso de entrenamiento hacia la implementación operativa.

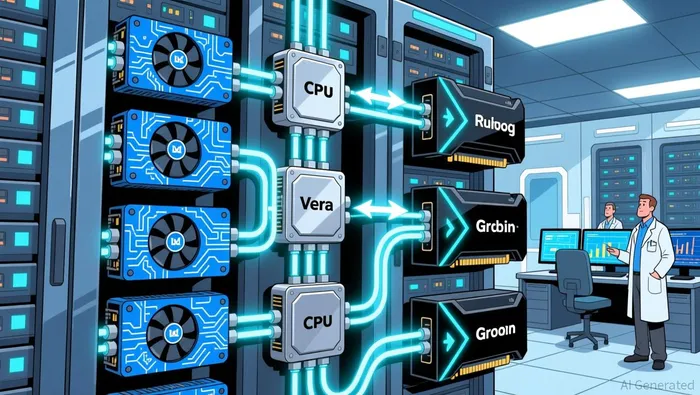

La inferencia se refiere a la ejecución en tiempo real de los modelos de IA: el proceso de responder a las consultas de los usuarios o tomar decisiones basadas en un modelo entrenado. Se trata de la demanda de procesamiento informático que impulsa a los chatbots, los motores de recomendación y los sistemas autónomos. A medida que la IA agente ganará más importancia, donde los agentes de software trabajen de forma autónoma, la necesidad de una inferencia eficiente aumentará aún más. La nueva plataforma Vera Rubin de Nvidia, junto con su alianza con Groq, licenciada por 17 mil millones de dólares, está diseñada específicamente para dominar este sector, prometiendo un aumento significativo en el rendimiento por vatio. La empresa ya no vende simplemente chips; ahora vende la infraestructura necesaria para el próximo paradigma de computación.

La plataforma full-stack: Vera Rubin y el agente OS

El enfoque de Nvidia no consiste simplemente en vender más chips. Se trata de desarrollar todo el sistema operativo necesario para la era de la inteligencia artificial agente. La empresa está construyendo una plataforma completa, diseñada para atraer a los clientes empresariales, al hacer que cambiar de proveedor sea algo extremadamente costoso y complicado. El elemento clave de esta estrategia es…Vera Rubin AI PlatformSe trata de un sistema de integración vertical que combina las nuevas GPU de Rubin, los procesadores CPU de Vera y los aceleradores de inferencia LPX de Groq, en un único dispositivo. No se trata simplemente de una colección de componentes separados; se trata de una estructura ingenieril en la que el hardware funciona mejor cuando está relacionado entre sí. Esto promete un rendimiento óptimo.Un rendimiento de inferencia 35 veces mayor por megavatios.Y también se proporciona soporte para modelos que son diez veces más grandes.

La capa de software es donde Nvidia busca estandarizar toda la industria. La empresa ha lanzado…OpenClawOpenClaw es un framework de IA de código abierto. Huang lo describió como “el sistema operativo para la inteligencia artificial personal”. Al compararlo con Linux y HTML, lo consideró como una capa fundamental en el funcionamiento de los sistemas de inteligencia artificial. Se trata de un paso estratégico para establecer las normas básicas para el funcionamiento de los agentes de inteligencia artificial: navegación por los sistemas, creación de sub-agentes y operación autónoma. La velocidad de adopción de OpenClaw ha sido excepcionalmente rápida; en pocas semanas, OpenClaw se convirtió en el proyecto de código abierto más popular de la historia. Para los líderes empresariales, esto significa que todas las empresas del mundo deben adoptar una estrategia basada en OpenClaw.

Este enfoque de plataforma se extiende más allá de los propios chips de Nvidia. La empresa colabora con proveedores de servicios como AWS, Azure y Google Cloud, así como con empresas como Dell e IBM, para integrar su tecnología en sus infraestructuras. Esto crea un ecosistema donde el costo de cambiar las herramientas utilizadas es muy alto. Una vez que una empresa desarrolla sus flujos de trabajo en OpenClaw y los implementa en una fábrica de IA como Vera Rubin AI, el costo y el riesgo de migrar a hardware o software de otros competidores se vuelven inmensos. Nvidia ya no vende productos comunes; está vendiendo las herramientas y los estándares necesarios para el próximo paradigma informático. El objetivo es aprovechar todo el valor en cada capa del proceso, asegurando así su dominio como líder en este campo.

Impacto financiero y ventajas competitivas

El cambio estratégico ya está dando como resultado una mayor fortaleza financiera y la creación de barreras de entrada muy sólidas para los nuevos competidores. Los últimos resultados trimestrales de Nvidia indican que la empresa opera con la máxima eficiencia posible. Para el trimestre terminado el 25 de enero de 2026, la empresa informó que…Los ingresos registrados fueron de 68.1 mil millones de dólares, lo que representa un aumento del 20% en comparación con el trimestre anterior.Más importante aún, su margen bruto sigue siendo excepcionalmente alto: el 75.2% en el último trimestre. Este nivel de rentabilidad indica que la empresa cuenta con un poder de fijación de precios considerable y un control efectivo de los costos. Esto le proporciona una gran capacidad financiera para financiar la próxima fase de desarrollo de la infraestructura. La perspectiva de pedidos por valor de 1 billón de dólares para el año 2027, anunciada en GTC, confirma aún más la confianza del mercado en esta trayectoria financiera.

La integración de la tecnología de Groq es un factor clave para lograr este dominio financiero y técnico. El acuerdo de licencia por 17 mil millones de dólares para los aceleradores de inferencia LPX de Groq tiene como objetivo lograr un aumento significativo en la eficiencia. Los resultados obtenidos con las pruebas de rendimiento realizadas por Nvidia muestran que la plataforma Vera Rubin, que combina las GPU de Rubin con los chips LPX de Groq, puede alcanzar niveles de eficiencia extraordinarios.Un rendimiento de inferencia hasta 50 veces mayor por megavatios.Esto no es simplemente una mejora gradual; se trata de un cambio radical en la densidad de procesamiento, lo que permite abordar directamente el problema principal relacionado con los costos energéticos por operación. Al licenciar esta tecnología en lugar de desarrollarla internamente, Nvidia obtiene una ventaja importante en términos de rendimiento, al mismo tiempo que reduce sus gastos de capital. De este modo, Nvidia acelera su camino hacia el liderazgo en el mercado.

Esto lleva al cuestionamiento central de los “abrigos competitivos”. La amenaza que representan lasASICes de los hiperescaladores ha sido un tema recurrente, pero la realidad es más compleja. Los trabajos de IA modernos no son tareas simples; son procesos multimodales, que requieren una gran cantidad de memoria, tecnologías avanzadas de empaquetamiento y un conjunto de software unificado. Como señala el análisis del sector,Las GPU verdaderamente avanzadas no pueden cumplir con estos requisitos.La transición hacia estos nuevos tipos de cargas de trabajo, en realidad, fortalece la posición de Nvidia. Esto genera una necesidad de utilizar la infraestructura que Nvidia está desarrollando. LosASICs para hipercargas encuentran su lugar en ciertos niveles de procesamiento que requieren un bajo consumo de energía. Pero no pueden replicar la amplitud de la plataforma full-stack de Nvidia, desde los chips hasta el sistema operativo.

En resumen, Nvidia está construyendo una barrera que la protege en cada nivel. Su motor financiero es sólido, y su rendimiento gracias a Groq es exponencial. Además, la complejidad arquitectónica del nuevo paradigma de IA crea una gran barrera para los competidores. Aunque el mercado seguirá siendo competitivo, el paso de la empresa de vender solo chips a vender todo el sistema operativo para la inteligencia artificial, le permite fijar a sus clientes y asegurar su lugar como la infraestructura indispensable para el próximo paradigma de computación.

Catalizadores, riesgos y lo que hay que tener en cuenta

El camino que va de una previsión de mil millones de dólares hacia una realidad de mil millones de dólares está marcado por ciertos hitos importantes. Para Nvidia, la validación a corto plazo de su teoría basada en la inferencia depende de dos factores clave: el lanzamiento comercial de sus sistemas de IA Vera Rubin y la adopción del framework OpenClaw por parte de los desarrolladores empresariales. Estos son los primeros testigos operativos de las posibilidades de esta plataforma. El diseño de referencia para la fábrica de IA Vera Rubin DSX, presentado en GTC, tiene como objetivo ayudar a los clientes a construir estos sistemas masivos. La verdadera prueba llegará cuando las primeras implementaciones empresariales comiencen a funcionar en producción, demostrando así las expectativas de Nvidia.Generación de tokens 15xY además, se necesita apoyo para modelos que puedan manejar hasta 10 veces más datos. Al mismo tiempo, la rápida adopción de OpenClaw como “sistema operativo para ordenadores agentes” debe traducirse en procesos de desarrollo tangibles y estrategias empresariales efectivas. Si estos sistemas y software se convierten en la opción predeterminada, entonces se confirmará que la estrategia de Nvidia de mantener un control sobre el mercado funciona.

Un riesgo importante en esta línea de tiempo es la ejecución del software en hardware nuevo y en colaboraciones con otros proveedores. El éxito de la plataforma Vera Rubin depende del rendimiento y de la disponibilidad de sus nuevas unidades centrales de procesamiento. Esto representa un desafío directo para los intereses de Intel. Además, la producción de los aceleradores de inferencia LPX, basados en tecnología Groq, es un aspecto crucial. Estos chips están siendo fabricados en masa por Samsung, una alianza anunciada durante la conferencia GTC. Cualquier retraso o problema en la producción de estos chips podría afectar negativamente al éxito de la plataforma Vera Rubin.Chip de 4 nmLa producción podría causar un bloqueo en todo el proceso de fabricación de Vera Rubin, retrasando así lo que se había prometido.Un rendimiento de inferencia 50 veces mayor por megavatios.El acuerdo de licencia de 17 mil millones de dólares es una apuesta por esta tecnología. Pero su valor real se logra cuando está en manos de los clientes.

Por último, es necesario observar el flujo de órdenes real en el mercado, en comparación con la estimación del valor de 1 trillón de dólares. Este número, que representa un aumento en comparación con los 500 mil millones de dólares del año pasado, es una señal muy importante sobre la situación de la curva de demanda. Aunque las perspectivas son positivas, cualquier desviación significativa –ya sea un ralentimiento en las decisiones de las empresas o un cambio en los gastos de los hiperescaladores– podría ser un indicio de problemas. La reacción del precio de las acciones ante este anuncio, con un breve aumento seguido por una disminución, muestra que los inversores son cautelosos debido a la creciente competencia. Los próximos trimestres nos mostrarán si ese libro de órdenes de 1 trillón de dólares se convierte en algo real o si se trata simplemente de un objetivo que necesita más tiempo para cumplirse.

Comentarios

Aún no hay comentarios